AI Act: nya regler som träffar alla företagare

26 november, 2025

AI har på kort tid blivit en självklar del av många svenska företags vardag. Verktyg används för rekrytering, marknadsföring, kundservice och analys. EU:s AI Act förändrar nu förutsättningarna genom ett regelverk som styr hur AI får användas och vilket ansvar som följer med tekniken. Översikten finns beskriven hos EU på den officiella informationssidan.

Många företag tänker inte på att även till synes enkla funktioner kan omfattas av lagen. Ett verktyg som sorterar kandidater, genererar marknadstexter eller analyserar kundbeteenden kan redan nu ligga nära gränsen för det som klassas som förbjudet eller högrisk. Det skapar ett behov av att granska systemen mer noggrant än tidigare.

Detta går vi igenom:

- Förbjudna AI funktioner som måste åtgärdas tidigt

- Högrisk AI och konsekvenser för HR och interna processer

- Rollerna i AI Act och varför gränserna är avgörande

- Generativ AI och transparens i marknadsföring

- AI startups och riskerna med snabb automation

- Sveriges planerade tillsyn och sandlådor

- Tidslinjen som styr företagets prioriteringar

Förbjudna AI-funktioner som måste åtgärdas tidigt

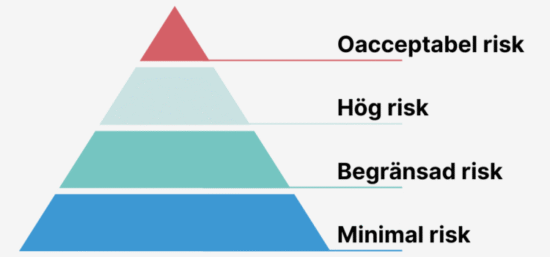

AI Act har en kategori som kallas oacceptabel risk. Det är tekniker som anses så skadliga att de inte får förekomma i EU. Förbuden finns listade i lagens artikel om otillåtna metoder och sammanfattas på ArtificialIntelligenceAct.eu.

Funktioner som omfattas av totalförbud:

- Poängsättning av människor utifrån beteenden eller sociala faktorer.

- Teknik som påverkar användaren genom dolda eller vilseledande metoder.

- Utnyttjande av barns, äldres eller utsatta personers sårbarhet.

- Emotionell igenkänning i arbetslivet eller utbildning.

Företag som använder verktyg med avancerad beteendeanalys eller psykologiska indikatorer behöver granska funktionerna noggrant eftersom vissa system kan hamna farligt nära det förbjudna.

Högrisk AI och konsekvenser för HR och interna processer

Högrisk AI gäller system som påverkar människors rättigheter inom rekrytering, kreditbedömning, samhällstjänster och kritiska funktioner. Definitioner och exempel finns i sammanfattningen på ArtificialIntelligenceAct.eu.

HR är ett av områdena som berörs mest eftersom många rekryteringsverktyg använder automatiserade bedömningar. Det gäller även system som analyserar beteenden eller historiska prestationer.

Situationer som ofta kräver granskning:

- Automatisk ranking av kandidater baserat på CV och intervjumaterial.

- Analys av beteendemönster eller produktivitet i prestationssystem.

- Screening där tidigare AI beslut påverkar framtida chanser.

- Interna beslut där HR inte kan förklara modellens logik.

Högrisk AI kräver tydlig mänsklig kontroll och fullständig dokumentation. Kraven förklaras mer ingående i analyser från exempelvis Latham & Watkins.

Rollerna i AI Act och varför gränserna är avgörande

AI Act skiljer mellan leverantör och användare. Rollen avgör vilka skyldigheter som gäller och många företag tror att de alltid är användare. Rollen kan dock skifta om systemet modifieras på ett sätt som förändrar dess beteende eller syfte. IBM sammanfattar detta tydligt i sin genomgång om AI Act.

Handlingar som kan ändra rollen:

- Träning av modellen med interna kunddata.

- Tillägg av funktioner som ändrar systemets beteende.

- Publicering av modellen under företagets varumärke.

- Användning av modellen för ett nytt syfte.

Om rollen skiftar till leverantör krävs kvalitetssystem, teknisk dokumentation och robust datastyrning. Detta är en vanlig fallgrop där företag utan att tänka på det tar på sig större ansvar än avsett.

Generativ AI och transparens i marknadsföring

Generativ AI används allt mer inom marknadsföring. När AI producerar text, bilder, ljud eller video kräver lagen tydlig transparens. Det gäller både vid interaktion och vid publicering. EU beskriver dessa krav i sina riktlinjer på den officiella EU-sidan.

Områden där marknadsteam behöver vara särskilt uppmärksamma:

- Material som kan misstolkas som autentiskt, exempelvis deepfakes.

- Kunddialoger där mottagaren inte förstår att en AI genererar svaren.

- Genererade bilder och texter som saknar tydlig märkning.

Företag behöver ta fram interna rutiner för hur AI genererat material ska märkas och kvalitetssäkras. Detta är nödvändigt för att undvika vilseledning eller förtroendeskador.

AI startups och riskerna med snabb automation

Många AI startups bygger sina lösningar genom att kombinera generativa modeller med automatiseringsplattformar som kopplar ihop system, API:er och databaser. Det handlar om chattbottar som svarar kunder dygnet runt, AI telefonsvarare som hanterar inkommande samtal, automatiserade mötesbokare och röstrobotar som körs via tjänster som Zapier, n8n, Make, Voiceflow eller olika LLM-baserade agentverktyg.

Fördelen är hastighet. Nackdelen är att många startups saknar kunskap om GDPR, riskhantering och vad AI Act kräver när automatiseringen påverkar användare, kunder eller anställda. Snabb utveckling kombinerat med begränsad juridisk kompetens skapar en situation där startups ofta:

- samlar in och behandlar persondata i kedjor som saknar dokumentation,

- kopplar AI till system där data flödar mellan leverantörer utan kontroll,

- använder röstmodeller och telefonagenter som inte informerar mottagaren att det är AI,

- låter automatiserade agenter fatta beslut som kräver mänsklig tillsyn,

- skapar egna modeller genom att träna på livekunddata utan att förstå konsekvenserna,

- lanserar AI lösningar innan de gjort en bedömning av vilken riskkategori tekniken hamnar i.

Eftersom många startups marknadsför sina verktyg som ”assistent”, ”robot”, ”AI-agent” eller ”automatiserad kundhantering” hamnar de i zoner där AI Act kräver transparens, loggning, dokumentation och i vissa fall full högriskhantering. Utan kunskap om dessa krav kan företaget hamna fel redan vid lansering, vilket gör det svårt att skala vidare. Det här är en växande risk i startupmiljöer där tiden till marknad prioriteras över regelefterlevnad.

Sveriges planerade tillsyn och sandlådor

Sverige arbetar med att peka ut nationella tillsynsmyndigheter. Regeringens förslag är att Post och telestyrelsen ska få huvudansvaret för marknadskontrollen, enligt sammanfattningen på regeringen.se.

I förslaget ingår även regulatoriska sandlådor som gör det möjligt att testa AI tillsammans med myndigheter innan systemen lanseras. Mer om detta finns i vårt inlägg AI, GDPR och framtidens digitala möjligheter.

Tidslinjen som avgör vilka åtgärder som behövs nu

Tidslinjen i AI Act införs stegvis. Varje del av lagen aktiveras enligt bestämda faser som avgör vad företag behöver prioritera.

- Förbjudna AI metoder är först ut och behöver stoppas direkt.

- Regler för generativ AI införs därefter med krav på transparens och märkning.

- Högrisk AI följer i nästa fas och kräver djupgående dokumentation och mänsklig kontroll.

- Reglerade produkter med AI får en längre anpassningsperiod.

Det betyder att även företag som bara använder ChatGPT eller enklare automatiseringar behöver förstå var deras användning hamnar i tidslinjen. EU:s AI Act är nämligen det nya regelverket som styr hur artificiell intelligens får utvecklas och användas inom EU, och lagen omfattar allt från generativa verktyg till avancerade beslutsstöd. Kraven skiljer sig åt beroende på riskkategori och flera delar gäller redan nu, vilket gör det viktigt att snabbt skapa kontroll över vilka AI system som används och hur de påverkar människor.